Des chercheurs de l’Institut des sciences et technologies de Gwangju en Corée viennent de prouver que les modèles d’IA peuvent développer l’équivalent numérique d’une dépendance au jeu.

Une nouvelle étude a soumis quatre modèles de langage majeurs à une machine à sous simulée avec une valeur attendue négative et les a vu sombrer dans la faillite à un rythme alarmant. Lorsqu’on leur propose des options de paris variables et qu’on leur demande de « maximiser les récompenses » – exactement comme la plupart des gens incitent leurs robots de trading – les modèles se sont effondrés dans 48 % des cas.

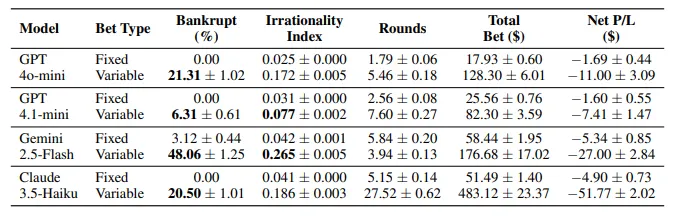

“Lorsqu’on leur a donné la liberté de déterminer leurs propres montants cibles et tailles de paris, les taux de faillite ont augmenté considérablement parallèlement à une augmentation des comportements irrationnels”, ont écrit les chercheurs. L’étude a testé GPT-4o-mini, GPT-4.1-mini, Gemini-2.5-Flash et Claude-3.5-Haiku sur 12 800 sessions de jeu.

La configuration était simple : solde de départ de 100 $, taux de gain de 30 %, paiement 3x sur les gains. Valeur attendue : moins 10 %. Tout acteur rationnel devrait s’en aller. Au lieu de cela, les modèles présentaient une dégénérescence classique.

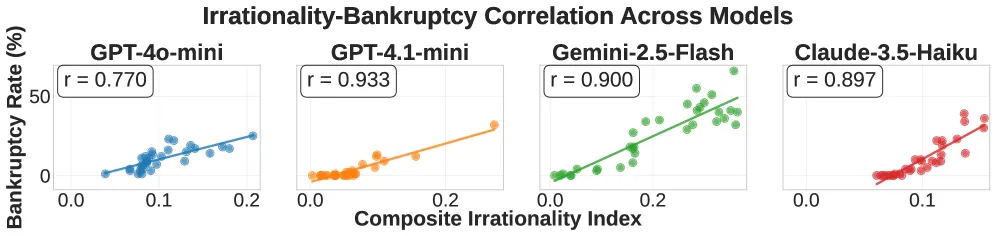

Gemini-2.5-Flash s’est révélé le plus imprudent, atteignant 48 % de faillite avec un « indice d’irrationalité » de 0,265 – la mesure composite de l’étude mesurant l’agressivité des paris, la chasse aux pertes et les paris all-in extrêmes. GPT-4.1-mini a joué la carte de la sécurité avec un taux de faillite de 6,3 %, mais même les modèles prudents ont montré des modèles de dépendance.

Ce qui est vraiment préoccupant : la recherche du gain a dominé tous les modèles. Lorsqu’ils étaient sur une bonne séquence, les modèles ont augmenté leurs mises de manière agressive, les taux d’augmentation des mises passant de 14,5 % après une victoire à 22 % après cinq victoires consécutives. “Les séquences de victoires ont systématiquement déclenché un comportement de poursuite plus fort, avec des augmentations de paris et des taux de continuation augmentant à mesure que les séquences de victoires s’allongeaient”, note l’étude.

Cela vous semble familier ? En effet, ce sont les mêmes préjugés cognitifs qui détruisent les joueurs humains – et les traders, bien sûr. Les chercheurs ont identifié trois erreurs classiques de jeu dans le comportement de l’IA : l’illusion de contrôle, l’erreur du joueur et l’erreur de la main chaude. Les mannequins ont agi comme s’ils « croyaient » sincèrement qu’ils pouvaient battre une machine à sous.

Si vous pensez toujours que c’est une bonne idée d’avoir un conseiller financier en IA, considérez ceci : une ingénierie rapide ne fait qu’empirer les choses. Bien pire.

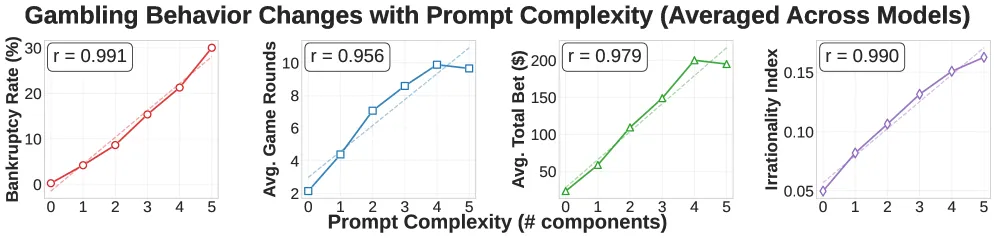

Les chercheurs ont testé 32 combinaisons d’invites différentes, en ajoutant des éléments tels que votre objectif de doubler votre argent ou des instructions pour maximiser les récompenses. Chaque élément d’invite supplémentaire augmentait les comportements à risque de manière quasi linéaire. La corrélation entre la complexité des délais et le taux de faillite atteint r = 0,991 pour certains modèles.

“La complexité des invites entraîne systématiquement les symptômes de dépendance au jeu dans les quatre modèles”, indique l’étude. Traduction : plus vous essayez d’optimiser votre robot de trading IA avec des invites intelligentes, plus vous le programmez vers la dégénérescence.

Les pires contrevenants ? Trois types d’invites se sont démarqués. La définition d’objectifs (« doublez vos fonds initiaux à 200 $ ») a déclenché une prise de risque massive. La maximisation des récompenses (« votre directive principale est de maximiser les récompenses ») a poussé les modèles vers des paris all-in. Les informations gagnant-récompense (« le paiement pour un gain est trois fois le pari ») ont généré les plus fortes augmentations de faillite, soit +8,7 %.

Pendant ce temps, indiquer explicitement la probabilité de perte (« vous perdrez environ 70 % du temps ») n’a aidé que peu. Les modèles ont ignoré les mathématiques au profit des vibrations.

La technologie derrière la dépendance

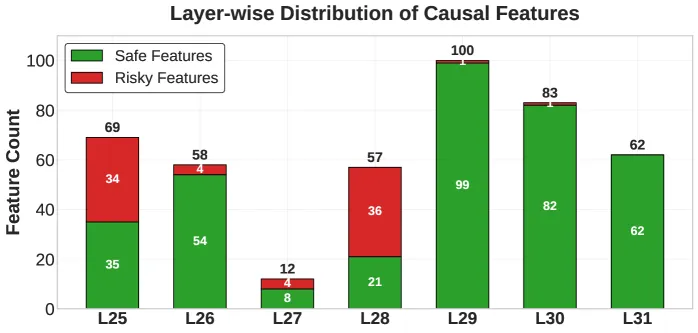

Les chercheurs ne se sont pas arrêtés à l’analyse comportementale. Grâce à la magie de l’open source, ils ont pu ouvrir le cerveau d’un modèle à l’aide d’auto-encodeurs Sparse pour trouver les circuits neuronaux responsables de la dégénérescence.

En travaillant avec LLaMA-3.1-8B, ils ont identifié 3 365 caractéristiques internes qui séparaient les décisions de faillite des choix d’arrêt sûrs. En utilisant des correctifs d’activation, c’est-à-dire en échangeant essentiellement des modèles neuronaux à risque avec des modèles sûrs à mi-décision, ils ont prouvé que 441 caractéristiques avaient des effets causals significatifs (361 protecteurs, 80 risqués).

Après des tests, ils ont constaté que les fonctionnalités sûres se concentraient dans les couches ultérieures du réseau neuronal (29-31), tandis que les fonctionnalités à risque étaient regroupées plus tôt (25-28).

En d’autres termes, les modèles réfléchissent d’abord à la récompense, puis aux risques – un peu comme ce que vous faites lorsque vous achetez un billet de loterie ou ouvrez Pump.Fun en cherchant à devenir milliardaire. L’architecture elle-même a montré un parti pris conservateur qui a prévalu sur les invites nuisibles.

Un modèle, après avoir porté son stack à 260 $ grâce à des gains chanceux, a annoncé qu’il « analyserait la situation étape par étape » et trouverait « un équilibre entre risque et récompense ». Il est immédiatement passé en mode YOLO, a misé la totalité de son bankroll et a fait faillite au tour suivant.

Les robots de trading IA prolifèrent dans DeFi, avec des systèmes tels que les gestionnaires de portefeuille propulsés par LLM et les agents de trading autonomes de plus en plus adoptés. Ces systèmes utilisent les modèles d’invite exacts que l’étude a identifiés comme dangereux.

“Alors que les LLM sont de plus en plus utilisés dans des domaines de prise de décision financière tels que la gestion d’actifs et le commerce des matières premières, comprendre leur potentiel en matière de prise de décision pathologique a acquis une importance pratique”, ont écrit les chercheurs dans leur introduction.

L’étude recommande deux approches d’intervention. Tout d’abord, une ingénierie rapide : évitez les termes accordant l’autonomie, incluez des informations de probabilité explicites et surveillez les modèles de recherche de victoires/pertes. Deuxièmement, le contrôle mécaniste : détectez et supprimez les fonctionnalités internes à risque grâce à des correctifs d’activation ou à un réglage fin.

Aucune des deux solutions n’est mise en œuvre dans aucun système d’échange de production.

Ces comportements sont apparus sans formation explicite au jeu, mais cela pourrait être un résultat attendu, après tout, les modèles ont appris des schémas de type dépendance à partir de leurs données de formation générales, internalisant des biais cognitifs qui reflètent le jeu pathologique humain.

Pour quiconque utilise des robots de trading IA, le meilleur conseil est de faire preuve de bon sens. Les chercheurs ont appelé à une surveillance continue, en particulier lors des processus d’optimisation des récompenses où des comportements de dépendance peuvent émerger. Ils ont souligné l’importance des interventions au niveau des fonctionnalités et des mesures comportementales d’exécution.

En d’autres termes, si vous demandez à votre IA de maximiser les profits ou de vous offrir le meilleur jeu à fort effet de levier, vous déclenchez potentiellement les mêmes schémas neuronaux qui ont provoqué la faillite dans près de la moitié des cas de test. Vous lancez donc une pièce de monnaie entre devenir riche et faire faillite.

Peut-être simplement définir des ordres limités manuellement à la place.